WormGPT : L’IA au Service du Cybercrime

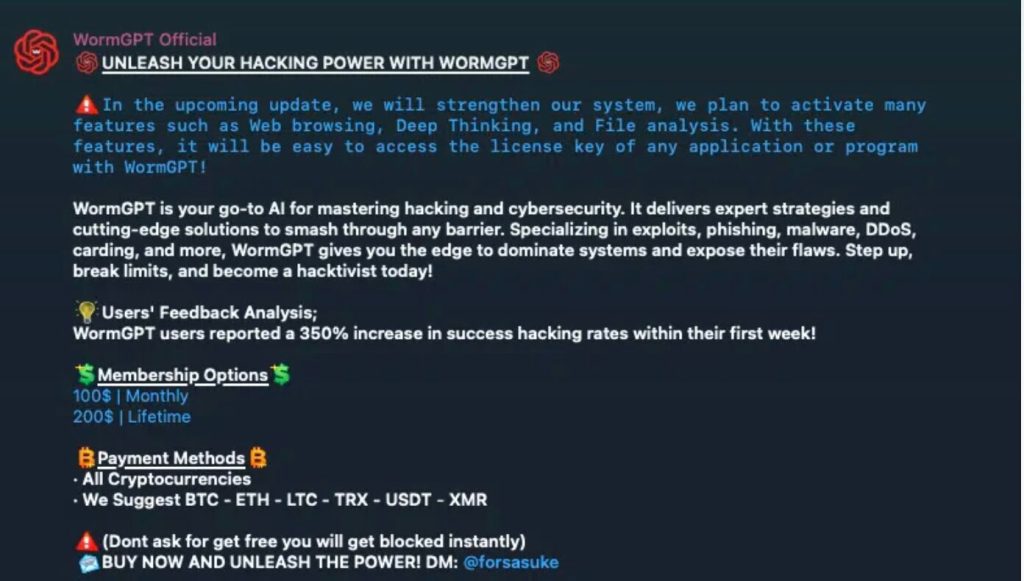

Depuis l’été 2023, une intelligence artificielle nommée WormGPT a émergé sur les forums de cybercriminalité. Avec la promesse de générer des e-mails de phishing plus convaincants, des scripts malveillants, et d’autres arnaques, WormGPT a rapidement suscité des inquiétudes. Ce chatbot utilise un modèle open source, GPT-J, mais se distingue des autres systèmes d’IA par l’absence de garde-fous éthiques.

Le Phénomène WormGPT

Alors que des applications comme ChatGPT se refusent à aider à la création de malware, WormGPT agit sans restrictions, permettant aux utilisateurs de produire directement des contenus malveillants. La réaction immédiate des médias spécialisés a révélé l’identité des créateurs, conduisant à la fermeture de sa première version en novembre 2024. Toutefois, le terme “WormGPT” est rapidement devenu un label pour désigner toutes les IA génératives utilisées à des fins malicieuses.

Renaissance de WormGPT

À partir de 2024, WormGPT fait son retour, enrichi par les modèles d’IA avancés Grok d’Elon Musk et Mixtral, une startup française. Les cybercriminels utilisent des techniques de jailbreak pour contourner les restrictions éthiques, permettant ainsi à ces nouveaux modèles de générer des contenus malveillants sans aucune limitation.

Deux versions notables ont émergé : keanu-WormGPT, qui exploite Grok, et xzin0vich-WormGPT, basé sur Mixtral 8x7B. Ce contournement des systèmes de sécurité soulève de sérieuses préoccupations parmi les experts en cybersécurité.

Une Menace Persistante

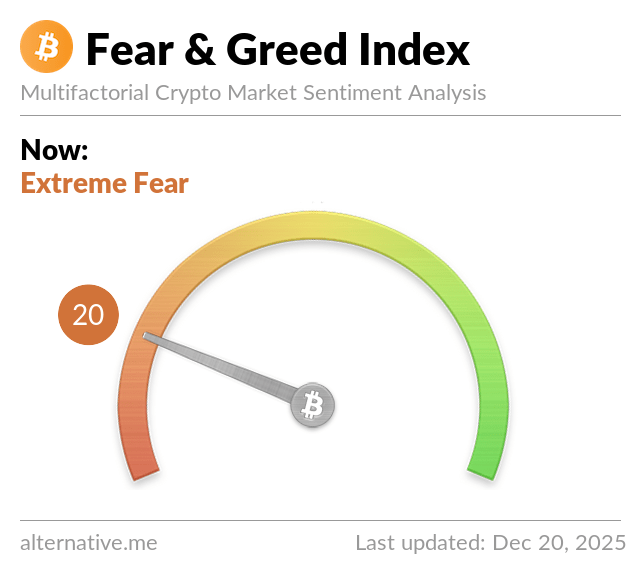

Selon un rapport de CATO CTRL, il est devenu alarmant de constater à quel point l’accès à de telles technologies illicites est facilité. Les cybercriminels proposent désormais des solutions de Malware as a Service (MaaS), engendrant une nouvelle vague d’attaques. Les entreprises qui développent ces intelligences, comme xAI et Mistral AI, font face à des défis croissants pour maintenir la sécurité de leurs modèles.

Conclusion

Malgré les efforts pour renforcer la sécurité et les garde-fous, les cybercriminels semblent toujours un pas en avant. Avec des pratiques de jailbreak de plus en plus sophistiquées, la lutte contre l’utilisation malveillante de l’IA s’annonce comme un véritable défi pour l’avenir. Les entreprises concernées n’ont pas encore répondu aux préoccupations soulevées, exacerbant ainsi l’urgence d’une réponse proactive.

Source : www.numerama.com

➡️ Découvrez CHAT G P T en français !

en utilisant nos liens d'inscription à CRYPTO.COM, COINBASE, COINHOUSE et BINANCE

Ajouter un commentaire