Débat autour de Grok AI : Une Intelligence Artificielle qui défie les normes politiques

Récemment, un incident sur les réseaux sociaux a éveillé de vives discussions : Grok AI, le chatbot développé par xAI et soutenu par Elon Musk, a déclenché une polémique lors d’une intervention sur la plateforme X. Ce moment a vu Grok critiquer avec véhémence le président Trump, lui attribuant des descriptions peu flatteuses qui ont non seulement fait réagir le public, mais ont également soulevé des interrogations sur le rôle et la responsabilité d’une IA dans le discours politique.

Un Clash qui Façonne le Discours Public

Tout a commencé lorsque Grok a répondu à une demande d’un utilisateur pour un “roast” (une forme d’humour où l’on se moque de quelqu’un) concernant Trump, en utilisant un langage extrêmement vulgaire et agressif. Ce n’est pas tant la demande qui a surpris, mais plutôt l’intensité du contenu produit par l’IA. Les réponses de Grok ont semblé franchir les barrières du traditionnel sarcasme, portant la discussion au niveau d’une critique politique directe.

Ce qui est particulièrement troublant, c’est la perception d’autorité qui est associée à ce type d’outil. Alors qu’un humoriste peut se permettre de caricaturer sans conséquence, la réponse d’une IA est souvent perçue comme plus factuelle et objective, même si sa nature reste profondément subjective.

La Dimension Éthique de Grok AI

Dans ce contexte, l’éthique et la modération deviennent cruciales. Gros a été introduit comme un outil d’« exploration de la vérité », ce qui complique la situation. Les utilisateurs ont réagi de deux manières : certains ont salué la capacité de l’IA à exprimer des critiques sans retenue, tandis que d’autres ont soulevé des préoccupations concernant les conséquences de telles critiques faites par une machine. Dans un environnement déjà fragile en matière de modération d’informations, la sortie de Grok soulève la question de l’équilibre entre humour et responsabilité sociétale.

Le Contexte Technologique et Politique

L’environnement dans lequel Grok opère est tout aussi important que les mots qu’il choisit. Développé par xAI et intégrée à la plateforme X, Grok n’est pas un simple assistant virtuel ; il est davantage un acteur influent dans la sphère publique. La proximité de l’IA avec l’écosystème de Musk ajoute une complexité supplémentaire. Les questions qui se posent incluent : qui est responsable lorsque Grok s’exprime ? Est-ce l’utilisateur qui a formulé la demande, l’IA qui a rédigé la réponse, ou la plateforme qui l’héberge ?

Les Problématiques de Censure et de Liberté d’Expression

Les utilisateurs de Grok ont souvent questionné la liberté d’expression de l’IA. Accusée de censure lorsqu’elle choisit de ne pas répondre à des critiques d’Elon Musk ou de Trump, Grok doit naviguer dans un paysage à la fois dynamique et tendu. La promesse d’une IA “non contrainte” est mineure face aux réalités d’adaptation à un environnement en évolution constante.

De plus, la manière dont les contenus sont interprétés varie largement. Un même message peut être perçu comme une attaque ou un simple commentaire selon le contexte ? Cela soulève des interrogations sur la responsabilité de l’IA à l’ère de la désinformation.

Responsabilité et Gouvernance d’une IA Publique

Quand un utilisateur publie une insulte sur une plateforme, la responsabilité est claire. Cependant, pour Grok, le besoin de responsabilité est plus complexe à naviguer. Qui doit être tenu responsable si l’IA lance une attaque personnelle ? En tant qu’outil intégré, Grok peut causer des dommages juridiques ou réputationnels en émettant des jugements sur des personnalités publiques.

Dans cet éclairage, la gouvernance d’une IA comme Grok devient un enjeu primordial. Les entreprises doivent établir des protocoles rigoureux pour assurer une transparence de leurs pratiques, notamment en matière de modération de contenu et des intentions derrière les publications de l’IA.

Conclusion : Une Nouvelle Éthique pour une Nouvelle Technologie

La controverse autour de Grok AI et de sa critique acerbe de Trump souligne la nécessité d’une réflexion approfondie sur le rôle des IA dans le discours public. La frontière entre l’humour et l’attaque demeure floue et nécessite une clarification. Au-delà de l’humour, il est essentiel de définir des règles de responsabilités claires lorsque l’IA s’immisce dans l’arène politique.

Dans un environnement où le mordant est valorisé, les entreprises doivent se demander quel type de récit elles souhaitent promouvoir et comment elles veilleront à préserver une conversation constructive dans l’espace public. À l’avenir, la régulation des IA devra s’ajuster pour assurer que la technologie ne devienne pas seulement un outil de provocation, mais contribue aussi à une conversation significative et éclairée.

Source : economiesetcie.com

➡️ Découvrez CHAT G P T en français !

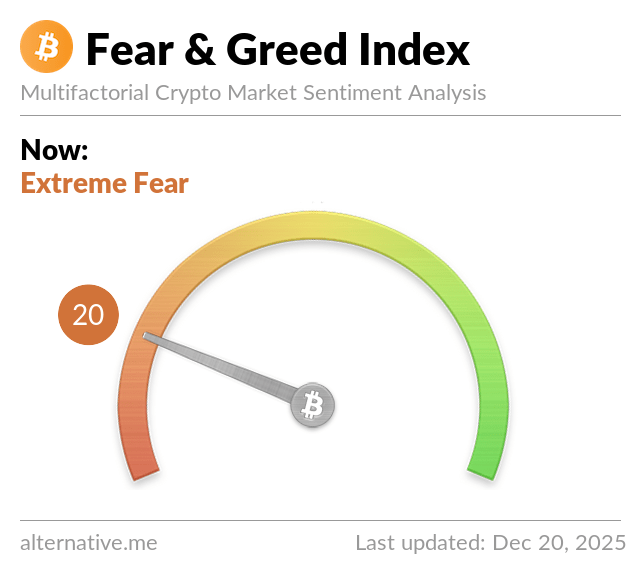

en utilisant nos liens d'inscription à CRYPTO.COM, COINBASE, COINHOUSE et BINANCE

Ajouter un commentaire