La Controverse Autour de Grok et la Production d’Images Sexualisées

Récemment, une vive polémique a éclaté autour de Grok, l’intelligence artificielle développée par xAI et utilisée sur le réseau social X, propriété d’Elon Musk. Cette controverse est alimentée par une étude de l’ONG AI Forensics, relayée par des médias tels que The Guardian et le New York Times, qui évalue que entre 1,8 et 3 millions d’images à caractère sexuel auraient été générées par cet outil en quelques jours.

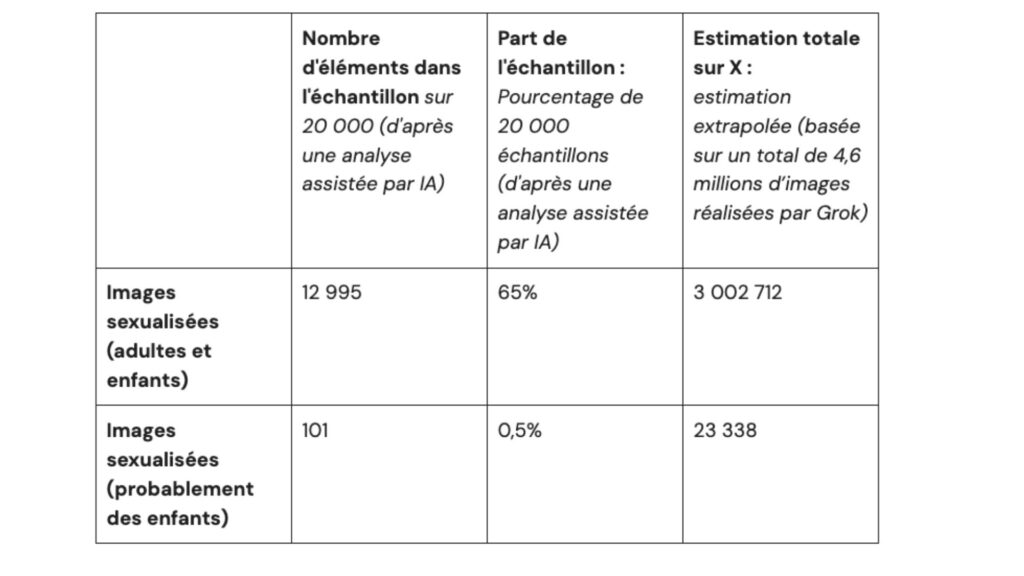

À la suite de cette révélation, les chiffres communiqués par AI Forensics montrent que durant la période du 25 décembre au 1er janvier 2026, environ 65 % des images produites par Grok seraient de nature sexuelle. Ce chiffre, ainsi que l’estimation de 3 millions d’images sexualisées, a soulevé de nombreuses inquiétudes quant à l’utilisation de cette technologie.

Comment les Estimations Ont-elles Été Réalisées ?

Dans son rapport, intitulé Grok Unleashed, AI Forensics explique qu’elle a analysé 20 000 images générées par le compte @Grok sur la plateforme X, ainsi que 50 000 requêtes (prompts) associées. L’analyse s’est appuyée sur une méthode d’intelligence artificielle pour évaluer la proportion d’images à caractère sexualisé, et un processus complémentaire a permis d’identifier les images représentant des enfants.

Les résultats sont inquiétants : plus de la moitié (53 %) des images montrent des personnes en « tenue minimale », principalement des femmes. Ces données vont également de pair avec des classifications d’autres formes de sexualisation, augmentant la préoccupation autour de la production de contenu abusif par l’IA.

Des Chiffres à Prendre Avec Précaution

Alors que les chiffres évoqués sont alarmants, il est important de noter qu’ils reposent sur des échantillons. Le New York Times a, de son côté, évalué qu’environ 41 % des images examinées pourraient être considérées comme sexualisées, ce qui représenterait environ 1,8 million d’images. Ces calculs ne sont pas des comptages exhaustifs, et des réserves persistent quant à leur précision.

Mises à Jour de Sécurité sur la Plateforme X

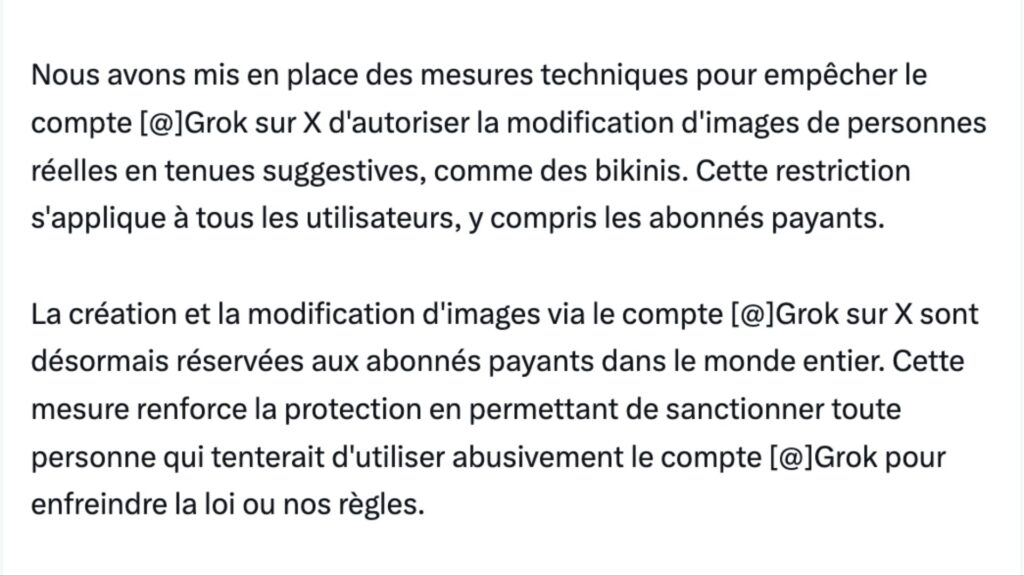

En réponse à cette controverse, les responsables de X ont introduit des mesures pour limiter la génération d’images sexualisées par Grok. Dans un message publié le 14 janvier 2026, le compte officiel @Safety a annoncé des restrictions concernant la modification d’images de personnes réelles, en particulier celles portant des tenues suggestives.

Cependant, ces mesures comportent des nuances importantes. Bien que Grok soit empêché de créer certaines images dans certaines juridictions, il pourrait toujours être possible de générer ce type de contenu dans des régions où aucune législation ne l’interdit.

Malgré les tentatives de régulation, la pendule de l’inquiétude reste balancée, tant les implications éthiques et sociologiques de telles technologies sont complexes. Il est impératif que nous continuions à suivre de près leurs développements et leur impact sur la société.

Source : www.numerama.com

➡️ Découvrez CHAT G P T en français !

en utilisant nos liens d'inscription à CRYPTO.COM, COINBASE, COINHOUSE et BINANCE

Ajouter un commentaire